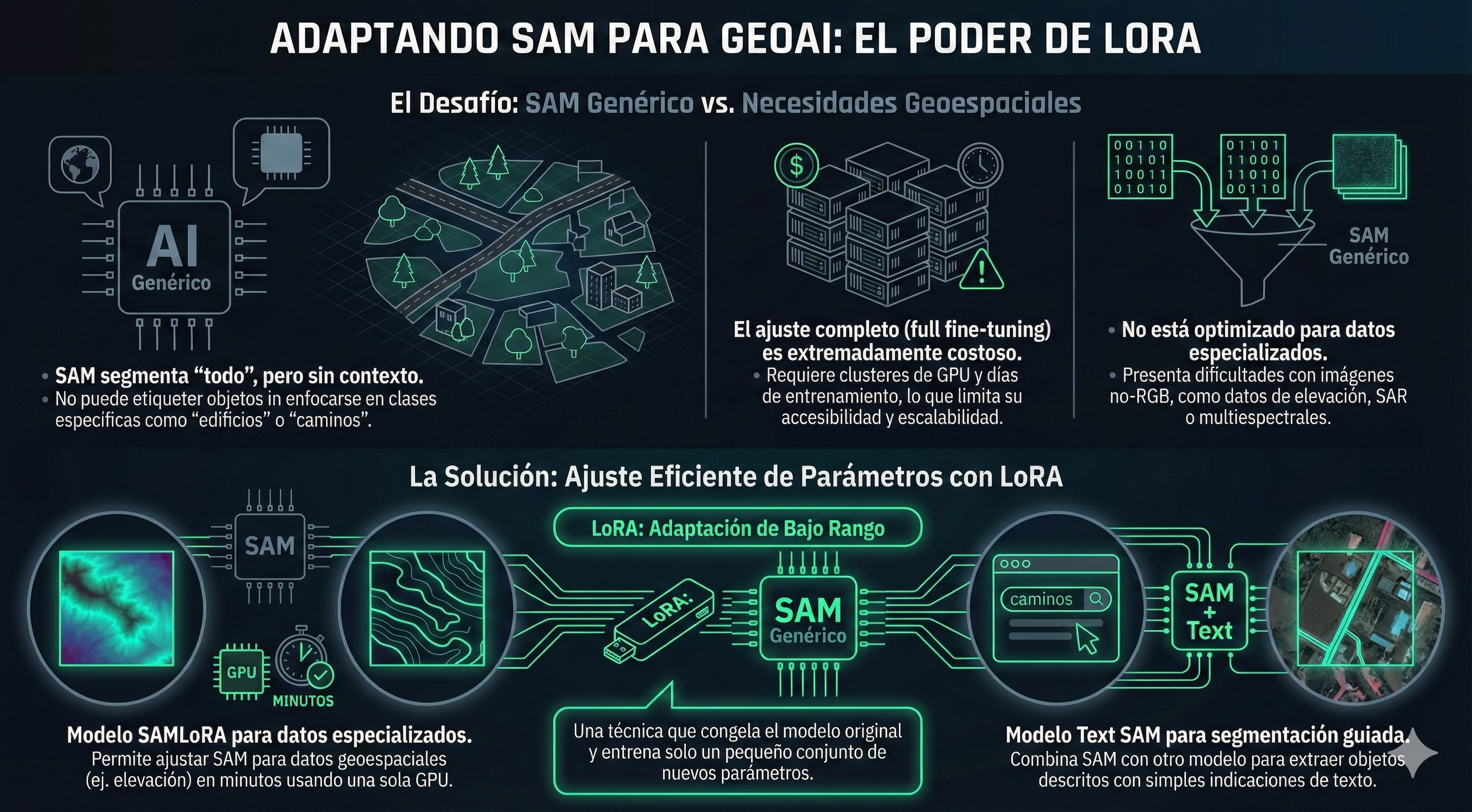

LoRA permite especializar el Segment Anything Model a la geografía de LATAM sin la última GPU.

El 2023 nos trajo el Segment Anything Model (SAM) y una promesa peligrosa: segmentar “lo que sea” con un clic.

Detrás hay un dato clave: SAM se entrenó con SA-1B (≈11M imágenes y >1B máscaras).

Kirillov et al., 2023: Segment Anything

El choque llega cuando lo sacas del mundo “foto natural” y lo tiras al mundo geoespacial: agricultura, catastro, asentamientos, agua con sedimento, laderas, nubes, sombras…

Ahí SAM no es “malo”: está fuera de su objetivo.

¿La solución clásica? Full fine-tuning. ¿La realidad LATAM? No siempre hay recursos, tiempo ni GPUs para hacerlo (y entrenar SAM “desde cero” fue una operación de escala industrial).

Kirillov et al., 2023: Segment Anything

Aquí entra LoRA (Low-Rank Adaptation): no como truco de optimización, sino como estrategia para que los foundation models dejen de ser “solo para Big Tech”.

Hu et al., 2021: LoRA

La idea (Hazte esta pregunta antes de tocar el modelo:)

¿Qué está fallando exactamente en tu caso: el modelo… o tu pipeline?

Porque en satélite, una mala decisión de escala/normalización puede destruir el valor antes de que SAM “la vea”.

El problema: SAM no “piensa” en datos geograficos

Si usas SAM out-of-the-box en imágenes satelitales, suele fallar por una mezcla de dominio y física. En literatura EO/RS se repite la misma idea: el desempeño zero-shot no siempre es satisfactorio y la adaptación se vuelve casi obligatoria en varias tareas.

Zhang et al., 2025: RSAM-Seg (Remote Sensing, MDPI)

Por qué pasa

Geometría cenital (nadir): aplana objetos, cambia bordes y borra señales que en foto natural ayudan.

Espectro y materialidad: SAM nace en RGB; en teledetección muchas separaciones dependen de NIR/SWIR/índices (vegetación, humedad, materiales).

Radiometría y atmósfera: reflectancias, 16-bit, bruma, nubes, sombras… si normalizas mal, el modelo “ve” un mundo roto.

Escala: el mismo “objeto” puede medir 3 px o 300 px según sensor/GSD. (Ahí no hay magia.)

La solución: LoRA explicado con Post-its

Piensa en SAM como un libro enorme, bien escrito… pero sobre otro planeta.

Full fine-tuning: reescribes capítulos enteros. Caro, lento y con riesgo de romper lo que ya funcionaba.

LoRA: no reescribes el libro; pegas Post-its entrenables donde hace falta. El texto base queda congelado; tú aprendes solo “la corrección”.

Hu et al., 2021: LoRA

LoRA aprende una actualización de bajo rango sobre matrices clave, logrando adaptación fuerte con una fracción de parámetros entrenables.

Hu et al., 2021: LoRA

Estrategia: menos “setup”, más criterio

La magia no está en “meter LoRA y ya”. Está en decidir qué enseñar y dónde tocar.

1) ¿Qué SAM estás usando (B/L/H)?

SAM tiene variantes (B/L/H). El “Huge” es pesado; para la mayoría de casos aplicados, SAM-B suele ser el punto de entrada sensato por costo/beneficio.

Kirillov et al., 2023: Segment Anything

Pregunta útil: si no puedes iterar rápido, ¿cómo vas a aprender del error?

2) ¿Dónde pones LoRA?

Dos escuelas comunes:

LoRA en el image encoder: más capacidad para adaptar texturas, bordes, patrones del dominio.

LoRA en el decoder: más barato, pero puede quedarse corto si el dominio está muy lejos.

Pregunta útil: si tu error es “no reconoce la señal”, ¿por qué empezarías ajustando lo último y no lo que “mira”?

3) El rango r: no hay número mágico

Regla práctica sin dogma: empieza en r = 16–32, mide y ajusta.

Hu et al., 2021: LoRA

4) Pre-proceso: el 80% del fracaso (o del éxito)

Dos verdades incómodas:

-

SAM está diseñado para 3 canales (RGB) y supuestos típicos de visión natural.

Kirillov et al., 2023: Segment Anything -

Si vienes de satélite en reflectancia / 16-bit, necesitas una transformación coherente antes de entrar a SAM.

Pregunta útil: ¿tu modelo falla por arquitectura… o porque tu pipeline convirtió reflectancia en ruido?

Casos de uso en LATAM (donde esto sí paga)

1) Asentamientos informales (geometría real, no ciudad de catálogo)

Los datasets típicos “buscan rectángulos”. En autoconstrucción, los bordes son otra historia: ladera, sombras duras, materiales mixtos.

LoRA brilla cuando le enseñas al modelo tu borde: el que aparece en tu territorio.

La letra chica: limitaciones reales (para no prometer milagros)

Cuello de botella RGB: si tu señal vive en 12 bandas, tienes que decidir cómo la “traducirás” (compuestos, índices, PCA, etc.). SAM no “ve” tus 12 bandas nativas por arte de magia.

Kirillov et al., 2023: Segment Anything

Normalización mata modelos: una mala escala radiométrica puede arruinarlo todo aunque el fine-tuning sea perfecto.

Objetos diminutos: si el objeto mide ~1 px, estás peleando con física, no con deep learning.

Cierre: LoRA no es “hacer trampa”, es hacer GeoAI sostenible y accesible

La próxima vez que un modelo falle en tu territorio, prueba esta pregunta antes de pedir más datos o más GPU:

¿Necesito más capacidad… o necesito enseñarle al modelo a con pocos ejemplos bien puestos?

🚀 ¿Quieres aprender haciendo?

Tengo un tutorial completo de SAM 3 (la versión más reciente) aplicado a imágenes satelitales. Es un Jupyter Notebook paso a paso, en español, con ejemplos prácticos de segmentación usando lenguaje natural. Sin LoRA, solo inferencia directa con el modelo foundation.

👉 Tutorial SAM 3 para Imágenes Satelitales: github.com/geoai-latam/SAM3GEO

7 ejemplos prácticos, desde text prompts básicos hasta exportación de máscaras. Todo documentado, todo reproducible.